YouTube lanza una herramienta para detectar "deepfakes"

especiales

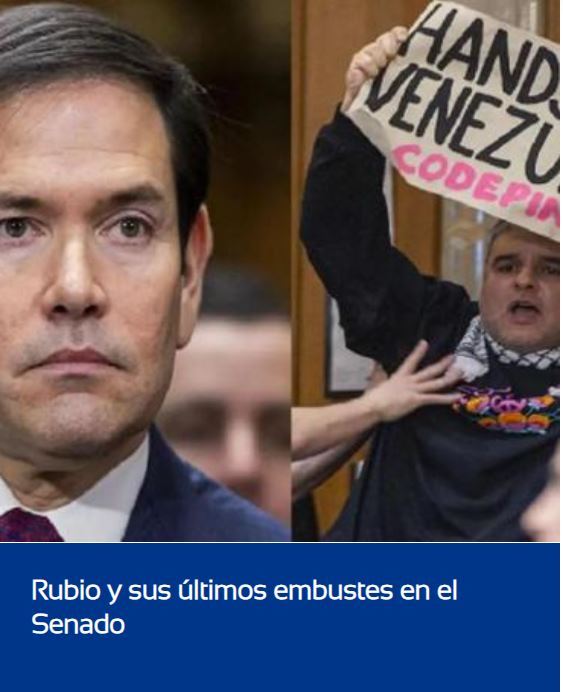

Donald Trump detenido, una imagen falsa creada con inteligencia artificial - TODOS LOS DERECHOS RESERVADOS

Tras anunciar la función el año pasado, YouTube está empezando a poner a disposición de los miembros de su programa de socios una nueva herramienta para reconocer videos no autorizados generados con inteligencia artificial, conocidos como "deepfakes".

La compañía, parte de Alphabet, la matriz de Google, la denomina "detección de semejanza", una forma de detectar casos en los que la IA ha utilizado o alterado el rostro de una persona sin su consentimiento para crear un nuevo video.

"Alguien ha creado un video que parece respaldar a un candidato político", explica la compañía, "o un anuncio que promociona un producto del que no sabes nada.

Puedes usar la herramienta para detectar posibles coincidencias".

El anuncio se produce unos días después de otra crítica al modelo Sora 2 de OpenAI, utilizado por usuarios en Estados Unidos y Canadá para generar videos con celebridades fallecidas, como Robin Williams y Martin Luther King Jr.

Las familias de ambos han solicitado oficialmente a la startup estadounidense que integre nuevas medidas de seguridad en su software para evitar resultados similares.

En concreto, el sistema de YouTube solicita a los usuarios que envíen un documento y un breve video selfie para verificar su identidad.

Posteriormente, pueden solicitar una revisión de la autenticidad del video publicado. Si se detecta una infracción, el contenido verificado será eliminado.

Técnicamente, según Engadget, el sistema funciona de forma similar al "ID de contenido" de YouTube, que se utiliza para detectar audio con derechos de autor en los videos y eliminarlo del fondo cuando sea necesario.

Por un lado, el anuncio de YouTube se alinea con la postura de la misma OpenAI, desarrolladora de la herramienta de generación de vídeo Sora, que ha reafirmado su restricción de no permitir la creación de videos que imiten a celebridades o figuras públicas.

En ambas se protege al contenido. Sin embargo, contrasta con el reciente anuncio de Sam Altman, director ejecutivo de OpenAI, respecto a ChatGPT y su propuesta para los usuarios.

A partir de diciembre, ChatGPT adoptará un cambio de rumbo significativo en su estrategia de moderación, buscando "tratar a los adultos como adultos" mediante la relajación de ciertas restricciones de seguridad, lo que incluirá la posibilidad de personalizar el tono del chatbot y, de forma más controvertida, permitir conversaciones eróticas para usuarios adultos verificados.

Esta medida proactiva no solo fortalece la protección de la identidad de sus creadores más valiosos, sino que también contribuye a mantener un entorno de visualización más confiable para la audiencia global, estableciendo un precedente importante sobre cómo las grandes plataformas deben abordar el uso malicioso de la IA generativa.

Añadir nuevo comentario